*Por Ricardo Stucchi

Vivemos a ascensão da inteligência artificial generativa. O ano de 2023 ainda começava quando o ChatGPT atingiu 100 milhões de usuários ativos mensais, se tornando o app de crescimento mais rápido da história – e essa é apenas uma das várias tecnologias de IA disponíveis. Apesar de engatinharmos nesse campo e não sabermos dos desdobramentos do tema, há uma inegável curva de aceleração, diferentemente do que ocorreu com outras grandes tendências, como a do metaverso, que chegaram rodeadas de especulação e expectativa. A inteligência artificial generativa apresentou mesmo resultados e aplicabilidade no dia a dia.

Se a IA generativa é um fato e as pessoas já estão usando-a no seu dia a dia, como as empresas devem gerenciar o uso dessas ferramentas por seus colaboradores? Um conceito já bastante conhecido no mundo da tecnologia começa a ser criado: depois da shadow IT, será que vem por aí a shadow AI?

O termo é uma referência a recursos de tecnologia que são utilizados por funcionários sem o conhecimento (e o aval) da equipe de TI, situação que gera uma série de riscos. E a TI precisa estar preparada para algo que me parece inevitável: sim, as pessoas vão testar essas ferramentas em suas rotinas, e elas estão disponíveis em grande variedade e sem custo.

Em primeiro lugar, não vejo que essa situação deva ser entendida como um problema, pois toda empresa busca (ou deveria buscar) por pessoas curiosas, profissionais que sempre querem aprender mais e se questionam se há meios mais simples de executar o que fazem no dia a dia.

Os melhores profissionais não ignoram novidades, querem entendê-las; não se contentam com a mesmice, buscam novas soluções. Uma vez que reconhecemos isso como fato, há três coisas que precisam ser consideradas:

A inteligência artificial chegou como um algoritmo inteligente e, ao mesmo tempo, popular – o uso é simples, intuitivo e até as versões gratuitas das diversas ferramentas produzem resultados de qualidade e que estão em constante evolução. Tudo isso faz com que seu uso seja amplo, para desespero de muitos. O que vai acontecer, por exemplo, se toda essa tecnologia for usada para propósitos questionáveis? Daí surgem os debates, sempre válidos, sobre regulação do setor.

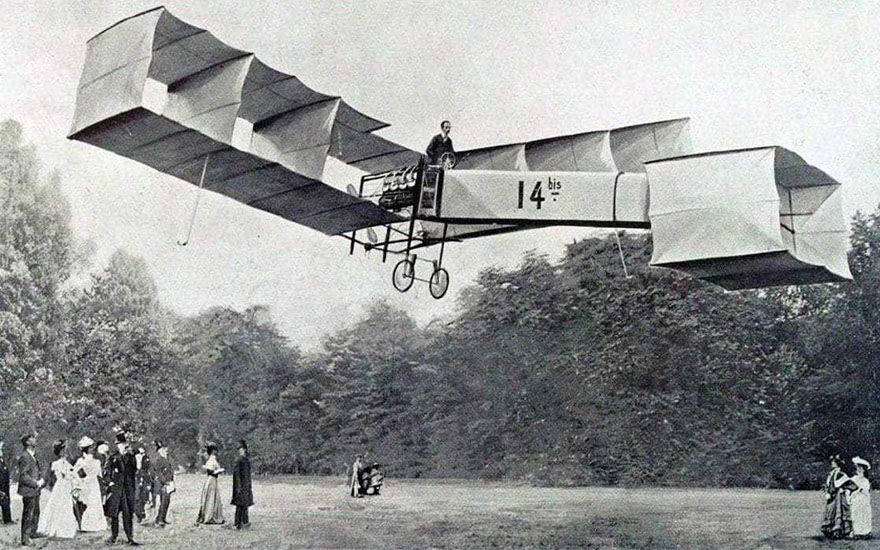

Há um paralelo aqui com um grande nome da ciência brasileira: Alberto Santos Dumont. Em 1932, o aeronauta e inventor foi encontrado morto num quarto de hotel do Guarujá. Embora a morte tenha sido registrada como por problemas cardíacos, logo espalhou-se a informação real e que alguns tentaram abafar.

Abalado com o uso que a humanidade fazia do avião, Santos Dumont se suicidou. Não fosse isso, o pai da aviação teria percebido que sim, a nova tecnologia foi usada para o mal e teve papel em guerras, mas também possibilitou uma conexão nunca vista do planeta e levou a humanidade adiante.

Para escrever este artigo, perguntei ao ChatGPT se ele sabia o que é shadow AI. Ele me respondeu: “Até a minha última atualização de conhecimento, em janeiro de 2022, “shadow AI” não é um termo amplamente reconhecido ou estabelecido na literatura ou na indústria de inteligência artificial. Pode ser que novos termos e conceitos tenham surgido desde então. Se “shadow AI” é um termo específico usado em algum contexto particular ou se tornou mais relevante após minha última atualização, recomendo verificar fontes mais recentes, como artigos acadêmicos, notícias da indústria ou documentação técnica, para obter informações atualizadas sobre esse termo e seu significado específico.”

Até o ChatGPT assume a sua ignorância e nós podemos aprender um pouco com isso. É impossível saber com exatidão o futuro dessa tecnologia. Mas, se usada com responsabilidade, a IA pode ajudar na busca por respostas.